Por fin empezamos hoy esta entrada múltiple sobre Escepticismo y Pensamiento

Crítico que dejamos pendiente hace unos cinco años, cuando hablamos del Método Científico.

Ya entonces dijimos que el Mundo en que vivimos es complejo,

y para poder comprenderlo, para poder manejarnos en él sin quedar abrumados por

la avalancha de información sensorial que nos rodea, necesitamos simplificarlo,

dar nombre a las cosas y encontrar patrones que nos permitan hacer predicciones

y tomar decisiones acertadas en la Vida… Pero hay quien simplifica demasiado las

cosas y llega a conclusiones erróneas; que nuestras ideas sobre el Mundo no se

correspondan con la realidad puede acabar ocasionándonos muchos problemas a

nosotros y a los que nos rodean.

Para esta

primera entrega he utilizado como punto de partida un texto muy extenso y

completo que me ha pasado muy amablemente mi amigo José Blanca, participante activo de Escépticos en el Pub Valencia. Se trata de una parte de

su libro sobre Filosofía de la Ciencia ya en las últimas etapas de redacción,

el capítulo con su selección de sesgos cognitivos,

que básicamente he resumido muchísimo, reordenando algunas cosas y añadiendo

otras pocas de mi cosecha… El armazón es todo suyo, así que es José el que debe

llevarse todo el mérito de este texto; si hay alguna incorrección, sin duda

forma parte de lo que he añadido yo a posteriori y por tanto es culpa mía.

Nuestra

capacidad para prever el futuro y hacer razonamientos abstractos es lo que diferencia

al Homo Sapiens

de otras especies animales, pero eso no nos hace perfectos ni totalmente

racionales. A veces justificamos de forma sesgada e ilógica algunas de nuestras

creencias previas, que no se ajustan a la realidad externa: esto no es

razonamiento sino racionalización,

y debe ser evitado. Un ser racional debe basarse en las evidencias disponibles

y en la lógica para llegar a conclusiones, sin retorcer los razonamientos en

beneficio propio o dejarse llevar por prejuicios.

Nuestros mecanismos

cognitivos nos permiten hacernos una idea general bastante acertada del entorno

que nos rodea de forma rápida y por tanto eficiente, lo que nos ayuda a tomar

las decisiones correctas; pero en ocasiones, cuando no necesitamos pensar tan

rápido, estos atajos mentales fallan llevándonos a conclusiones irracionales.

Un problema añadido está en que a menudo este procesado de la información

disponible es inconsciente y por tanto es difícil analizar si ha sido correcto

o no.

Evolutivamente

nuestra mente se ha adaptado para proporcionar una respuesta rápida a partir de

la limitada información que nos llega, con la finalidad de sobrevivir por

ejemplo al ataque de un depredador,

sacrificando la precisión en las conclusiones en aras de la celeridad. No

siempre disponemos de tiempo para sopesar cuidadosamente los pros y los contras

de cada decisión, y por tanto recurrimos a experiencias propias anteriores, a

las que otros compañeros nos han relatado o incluso a creencias populares para

acelerar el proceso. Esto hace que a veces cometamos errores en nuestras

apreciaciones. Si ignoramos que nuestro cerebro ha sido diseñado por la selección

natural para detectar peligros y generar en ocasiones falsas alarmas,

podemos acabar siendo pasto de la ansiedad o teniendo una visión totalmente distorsionada

de la realidad.

Estas pequeñas

trampas, estos fallos debidos al modo en el que pensamos, se denominan sesgos cognitivos y como decimos a veces

son difíciles de identificar. Cuando tenemos que explicar cómo hemos llegado a

una conclusión solemos ser capaces de hacerlo, aunque es muy probable que los

motivos de tipo emocional que nos llevaron inicialmente a ella, ignorando las

evidencias disponibles, no coincidan con los que usaremos después para intentar

justificarla: a eso es a lo que se llama racionalizar. Tal vez recordaréis que

ya he hablado otras veces en el blog de la gente que piensa como vive…

Pues a esto me refería.

El hecho de estar

en sociedad también puede hacer que nos alejemos de la búsqueda de la Verdad:

nuestro status dentro del grupo puede depender de nuestra capacidad para ganar

de forma activa las discusiones, aun recurriendo a métodos poco racionales; o

en una posición más pasiva, podemos en otros casos evitar los conflictos y

reforzar nuestra pertenencia al grupo renunciando a defender una postura

racional que pudiese contradecir las ideas previas de nuestros compañeros.

Reconocer estos sesgos o prejuicios innatos de los que somos víctimas debe ser

parte de nuestro aprendizaje como miembros de la sociedad.

Puede ocurrir

a veces que, en lugar de por tener una información incompleta o limitada,

lleguemos a conclusiones erróneas por disponer de demasiados datos a la hora de

buscar patrones… Un ejemplo de esto son las pareidolias,

por las que creemos reconocer formas donde solo hay estímulos visuales aleatorios: ya hace milenios, al mirar al

cielo nocturno, nuestros antepasados vieron constelaciones donde solo había

grupos de estrellas más brillantes distribuidas al azar y casi siempre muy

alejadas unas de otras, lo que derivó en el zodíaco y en las supersticiones asociadas al horóscopo.

Sin necesidad

de retroceder tanto en el Tiempo, en un estudio científico moderno en el que se

disponga de un gran número de medidas o datos será bastante probable encontrar

una pequeña correlación que creemos significativa cuando no lo es: existen

herramientas estadísticas para ayudarnos en estos casos, pero hay un gran

porcentaje de científicos que no saben usarlas correctamente,

con lo que se llega a conclusiones erróneas.

Otro sesgo que

hay que intentar tener en cuenta, para evitarlo, es el de disponibilidad,

por el que emitimos un juicio en base a la información que recordamos sin ser

conscientes de que habitualmente recordamos más los hechos llamativos, olvidándonos

de los monótonos aunque sean mayoría. Este sesgo influye por ejemplo en nuestra

evaluación de riesgos: es miles de veces más probable morir de accidente

doméstico que de ataque de tiburón blanco, pero nos dan más miedo los escualos

porque se han hecho más películas sobre ellos.

Nuestras

limitaciones con las probabilidades son especialmente remarcables cuando los

números implicados son muy grandes o muy pequeños, hasta el punto de que hay

negocios como la lotería, el bingo o los casinos

basados precisamente en explotar esta vulnerabilidad y aprovecharse de la

ilusión de la gente. Pensamos que a alguien le tiene que tocar el Gordo, y que

si tanta gente juega por algo será, pero si dividimos el importe del premio

precisamente por ese gran número de participantes nos quedará la ganancia

promedio que nos corresponde considerando todos los casos posibles, y esta es

siempre ridículamente más pequeña que las pérdidas que hemos tenido comprando

el décimo… Estos juegos están diseñados para que la Banca siempre gane, pero seguimos

picando porque a nuestros sesgos con las probabilidades se une el factor

social: ¿Qué cara se te quedaría si en tu trabajo todos compran menos tú

y luego toca ese número?

Puede ocurrir

no solo que recordemos únicamente los hechos más llamativos, sino que

introduzcamos sin querer elementos falsos en nuestros recuerdos… Nuestra memoria

no almacena un registro detallado de lo que nos ocurre, sino una idea general

del episodio en cuestión, y cada vez que accedemos al recuerdo rellena los

detalles que nos faltan, modificándolo ligeramente una y otra vez hasta que

cualquier parecido con el episodio original es una mera coincidencia. Se han

dado incluso casos de recuerdos sobre hechos muy impactantes que eran

completamente inventados, fruto de la sugestión. Por eso en las investigaciones policiales se le da mucho más

peso a las pruebas objetivas o a las filmaciones del hecho original que a los

testimonios orales sobre el suceso.

Relacionado

con el sesgo de disponibilidad está el famoso "Pues a mí me funciona"… Hay

quien pilla un resfriado y recurre a un remedio de su abuela, sintiéndose mejor

un par de días después y llegando a la conclusión de que el remedio en cuestión

es mano de santo, de que funciona, cuando en realidad son las defensas de su organismo

las que han combatido al virus… Una sola observación no es suficiente para

llegar a una conclusión fiable, para ello hay que realizar más observaciones y

analizar los resultados de forma objetiva y sistemática, controlando muy bien

cada una de las variables implicadas.

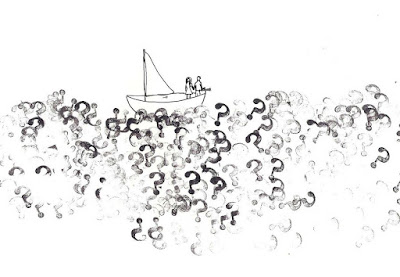

Una buena opción

cuando no tenemos pruebas suficientes para llegar a una conclusión sólida es la

de no llegar a ninguna. Ya hemos hablado otras veces en el blog de que admitir

que hay preguntas para las que todavía no tenemos respuesta es una de las grandes

virtudes de la Ciencia… No hay que tener miedo a no saber,

siempre y cuando haya voluntad de seguir aprendiendo, de seguir formulando

preguntas; si ya lo supiéramos todo acerca de todo

nos faltarían metas y nuestra Vida sería muy aburrida.

Y si renunciar

a una conclusión débil es algo bueno, renunciar a utilizar una evidencia sólida

a pesar de tenerla constituye otro tipo de sesgo. Elegir las observaciones que

egoístamente más nos interesan para que nuestros razonamientos nos lleven a una

determinada conclusión, cambiando incluso para ello el criterio de selección de

datos sobre la marcha, se conoce como falacia de la evidencia incompleta

o cherry picking. Un sesgo relacionado con este es el de confirmación,

por el cual escogemos inconscientemente las evidencias a considerar en función

de que confirmen o rechacen nuestras ideas previas… Un ser verdaderamente

racional debería criticar sus propias ideas tan severamente como las de los

demás.

Es por sesgos

como estos que los artículos científicos útiles y rigurosos acaban mezclados

con otros mal diseñados o directamente fraudulentos… O puede que la opinión

general acerca de un tema quede sesgada no ya por la selección de datos para un

experimento, sino por la selección de los experimentos que se publican en

función de sus conclusiones, algo que la industria farmacéutica

ha hecho en numerosas ocasiones… Supongamos por ejemplo que se realizan una

serie de experimentos de parapsicología,

todos ellos con un protocolo estricto y adecuado, y solo en uno de ellos se

encuentra una mínima correlación que es significativa estadísticamente por un

mínimo margen… Si este es el único estudio que acaba publicándose, estaríamos

distorsionando la realidad de todos modos.

Otro rasgo muy

humano, y muy común en el pensamiento conspiranoico, es el de imaginar detrás

de un suceso debido al azar a una mano negra, a un agente con una determinada

intención. Esta detección excesiva de intencionalidad, al igual que la de

patrones, puede tener una razón adaptativa, para ayudarnos en nuestras

relaciones con los demás. Los hay incluso que encuentran intencionalidad en el Mundo

Natural, aunque no haya involucrado ningún individuo propiamente dicho. En

tiempos antiguos se pensaba que eran los dioses los que producían las tormentas, los eclipses o los terremotos, y

no las leyes naturales; todavía no conocíamos la Ciencia, no sabíamos hablar el

idioma del Universo, y por tanto nos traíamos el problema más a nuestro

terreno, humanizando estos fenómenos de la Naturaleza para tratar de comprenderlos

un poco mejor y dotar de cierto orden al Mundo que nos rodea… Todavía hoy en

día hay gente que podría pensar, al apagarse una vela en una habitación con las

ventanas cerradas, que ha sido un fantasma

el que lo ha hecho con intención de asustarnos.

Además de

encontrar agentes del cambio donde no los hay, también es típico de nuestro

cerebro suponer que el Mundo y las personas que hay en él existen por un

motivo, o que las cosas que suceden tienen un propósito: a esta creencia se le llama

teleología. Por ejemplo, ante

un desastre natural una persona religiosa podría pensar no solo que lo ha

causado Dios, sino que lo ha hecho para castigar a los habitantes de esa zona… La

Ciencia sin embargo busca causas para los fenómenos que estudia, pero no

propósitos.

Otro tipo de

suposición inconsciente que hace nuestro cerebro es la del esencialismo, por el

cual las personas, animales, plantas, sustancias u objetos poseen una esencia

oculta e inmutable que define su comportamiento aunque varíen su apariencia o

las condiciones en las que se presenten. Por eso hay personas que piensan que

aunque una solución homeopática se diluya hasta que prácticamente no queden

moléculas del compuesto activo, sigue preservando la esencia del mismo,

lo cual puede ser muy romántico pero no se sostiene de ninguna de las maneras bajo el

punto de vista de la Química y la Biología más elementales…

Y es que la

lógica dicta que para evaluar la eficacia de un tratamiento no solo hay que

tener en cuenta los ensayos clínicos que se hagan con él, sino también los

conocimientos previos de que dispongamos en ese campo (en este caso nociones de

Química, el concepto de átomo

o el Número de Avogadro).

Confirmar una hipótesis que vaya en contra de estos conocimientos previos

requiere aportar pruebas realmente sólidas, o como reza el aforismo de Carl

Sagan: una afirmación extraordinaria requiere evidencias igualmente extraordinarias

para poder ser aceptada.

Aunque las redes sociales,

bien utilizadas, juegan un papel muy positivo en la divulgación del

Conocimiento, la difusión en ellas de información no contrastada se convierte

en un grave problema, al afectar potencialmente a un número tan alto de

personas y al ser tan fácil compartir contenidos. Hay mucha gente que decide

reenviar simplemente leyendo el titular de una noticia y confiando en el

conocido que se la ha mandado o en el medio de comunicación responsable de su

difusión, sin pensar que a veces estos no han comprobado su veracidad

apropiadamente. Un solo punto débil en la cadena puede dar lugar a una

verdadera avalancha de desinformación, sobre todo dentro de amplios sectores de

población que aceptan rápidamente una información sesgada o falsa

siempre y cuando refuerce sus creencias.

Además, el

objetivo de las empresas detrás de estas redes sociales no es que tengas una

visión completa y precisa del Mundo que te rodea, sino que las utilices el

mayor tiempo posible, con lo que intentan no sacarte de tu zona de confort e

introducen sesgos en sus algoritmos

para que los contenidos que se te sugieran no vayan en contra de tus creencias

previas. De esta manera creamos a nuestro alrededor una burbuja en la que no se

cuestionan nuestras ideas, una cámara de eco

en la que no hay verdadero debate ni esfuerzo intelectual. Si no nos

acostumbramos a hacer un fact check

de la información que nos llega y a tener la mente abierta a todo tipo de ideas

confundiremos el eco de nuestros prejuicios con discusiones críticas, y

nuestras racionalizaciones colectivas con razonamientos.

Y estos sesgos

que en principio no son malintencionados, por ser muchas veces inconscientes,

representan solo la punta del iceberg… Existen grupos organizados con ciertos

objetivos políticos o comerciales que en ocasiones utilizan cuentas de usuario

virtuales, los llamados bots sociales,

para dar una falsa impresión de popularidad de las ideas que quieren difundir e

implantar en la cabeza de la gente.

A estas operaciones en las que una campaña orquestada desde las sombras se

disfraza de movimiento social espontáneo se les denomina astroturfing,

y en los últimos años han sido las causantes de grandes cambios, inclinando de

un lado o del otro el resultado de referendums como el del Brexit en Reino Unido

y elecciones como las de 2016 en Estados Unidos.

Dejemos por

ahora las redes sociales… Estudios recientes han demostrado que en determinados

casos el grado en que una persona sobreestima su nivel de conocimiento en un

área dada es inversamente proporcional a lo que sabe de ese tema: cuanto menos

sabemos sobre algo, mayor es la diferencia entre lo que creemos conocer y lo que

realmente sabemos… O en otras palabras: la ignorancia es muy atrevida.

La adquisición de un conocimiento profundo sobre un campo determinado y por

tanto el ser conscientes de su complejidad nos confiere, contrariamente a lo

esperable, una cierta humildad y perspectiva, haciéndonos más prudentes en lo

que respecta a nuestras conclusiones.

Precisamente una de las razones para el éxito de la Ciencia es que parte de la

base del Escepticismo, la duda y la humildad, no de la confianza ciega en nuestras

propias capacidades. Las teorías científicas deben estar siempre abiertas a

revisión y a la introducción de mejoras.

Podríamos

pensar que la gente con un mayor coeficiente intelectual es menos vulnerable a todos

estos sesgos cognitivos de los que estamos hablando, pero se ha demostrado que

precisamente a ellos les resulta más fácil encontrar justificaciones para sus

ideas previas, y están menos dispuestos a aceptar posiciones opuestas a las

suyas. Ya en otra ocasión hablamos aquí de las inteligencias múltiples,

y vimos que la diferencia entre ser listo, inteligente o sabio es muy sutil y

está llena de matices…

La gente lista tiene una mayor habilidad para detectar patrones, por lo que es

capaz de hallar conexiones incluso donde no las hay si quiere justificar sus

ideas; y si además la persona en cuestión tiene muy buena memoria para recordar

los datos que le interesan, el problema se agrava aún más. Por ejemplo, un

negacionista de un fenómeno tan complejo como el cambio climático

tiene una gran cantidad de datos disponibles a su disposición, y si sabe

seleccionarlos bien y dar a sus argumentos una apariencia de coherencia interna

conseguirá sumar muchos adeptos a su causa.

Tampoco tiene

por qué ser garantía de racionalidad el gozar de un alto nivel educativo:

diversos estudios han concluido que los alumnos universitarios presentan las mismas creencias paranormales,

y en un grado similar, que el resto de la población. Los profesores

universitarios sin embargo son menos crédulos que sus estudiantes, aun con

diferencias importantes entre los de Ciencias, más racionales, y los de Humanidades.

Personalidades aparentemente brillantes como Steve Jobs

o Peter Sellers murieron de forma prematura por confiar en las pseudoterapias

para tratar sus enfermedades; el bioquímico y premio Nobel Kary Mullis

afirmaba que los extraterrestres nos visitan con regularidad; y las ideas sobre

los beneficios de la vitamina C del doble premio Nobel Linus Pauling

fueron el origen de una pseudociencia denominada medicina ortomolecular.

De todos modos

estos procedimientos basados en la Razón, la lógica y el análisis cuidadoso no

siempre son aplicables al 100%, especialmente cuando no disponemos de

suficientes datos o cuando los sistemas estudiados son muy complejos,

y por tanto no debemos otorgar el mismo grado de confianza a cualquier conclusión

etiquetada como científica. Por lo general las predicciones que realicemos en

el campo de las Ciencias Naturales serán más fiables que las de las Ciencias Sociales:

ya cuando hablamos en el blog de la Ciencia como “método infalible”

vimos que no es lo mismo por ejemplo intentar comprender el movimiento de caída

de una esfera por la gravedad que la interacción entre las distintas economías

mundiales…

Por tanto el Pensamiento

Crítico no consiste en criticar por sistema a los demás, sino en hacer un

análisis racional de las distintas creencias imperantes en la actualidad, y muy

especialmente de las propias. Richard Feynman dijo que la primera regla del

escéptico debía ser no engañarse a sí mismo,

algo que suele resultar bastante fácil. Una forma de poner a prueba tus

conclusiones y las de los demás es realizar en tu cabeza un debate con un

adversario imaginario al que le supones una gran inteligencia y un buen arsenal

de contraargumentos; simplemente el hecho de explicar tus ideas a otra persona

o incluso a ti mismo, verbalizándolas y poniéndolas en negro sobre blanco, te

facilita encontrar sus puntos débiles e identificar posibles racionalizaciones

y justificaciones arbitrarias.

Uno de los

pilares en los que se asienta nuestra personalidad es la necesidad de mantener

la autoestima, y muchas veces nos consideramos mejores de lo que realmente somos;

resulta gracioso que bastante más del 50% de los conductores españoles creen tener

un nivel de habilidad por encima del promedio, algo que estadísticamente es muy improbable…

Este sesgo hace que pongamos en duda los argumentos que van contra nuestras

creencias previas y sin embargo aceptemos sin reparos los que van a favor de

nuestros puntos de vista, ya que estar equivocados daña nuestra autoestima y

tener razón la fortalece.

Una manera de solucionar

este problema consiste en intentar asociar nuestra satisfacción no a ganar las discusiones,

sino a llegar a las conclusiones más sólidas, coherentes y racionales posibles,

exponiendo nuestros argumentos y escuchando atentamente los de los demás, ya

estén de acuerdo con nuestras ideas previas o no. Debatir con un adversario (no

enemigo, ojo) que sea racional y tenga un punto de vista diferente siempre será

enriquecedor. Que nos hagan cambiar de idea sobre algo no debería ser motivo de

tristeza por haber estado equivocados, sino de alegría por haber corregido el

error. Tenemos que intentar conceder menos importancia a nuestras antiguas

creencias que al proceso de generar otras nuevas, y debemos intentar que ese

proceso sea lo más racional posible, tratando de evitar las trampas que nos tiende nuestro cerebro, para que nuestras

nuevas creencias sean mejores que las antiguas.

Esto a veces

no es sencillo viviendo en sociedad, porque requiere también un cambio de

perspectiva en aquellos que te rodean, que se ven afectados por los mismos sesgos y tal vez prefieren

tener a alguien que nunca se equivoca como amigo, compañero de trabajo o jefe…

Este cambio de paradigma debe ser además difícil de aceptar para personas cuya

identidad está basada en creencias muy queridas y arraigadas, aunque no muy

racionales, como la de la existencia de Dios,

pero de eso ya hablaremos en otra ocasión… Con esto terminamos por hoy; durante

las próximas semanas trataré el tema desde otros ángulos, entrando por ejemplo

a enumerar y explicar por encima las distintas pseudociencias que campan a sus

anchas en la actualidad, y os contaré más detalles sobre las interesantes

charlas mensuales de Escépticos en el Pub Valencia.

No hay comentarios:

Publicar un comentario